在当今高度依赖云端服务的数字化时代,云端转发作为数据流与指令传输的关键枢纽,其稳定性与流畅性直接关系到用户体验与业务连续性。在实际运维中,“卡顿”与“报错”如同两片挥之不去的阴云,时常困扰着开发者与运维人员。本文旨在从一线实践者的视角,系统性地剖析云端转发卡顿与报错的根源,并提供一套从精准诊断到彻底优化的完整行动指南,以期帮助读者构建更健壮、高效的云端转发体系。

我们必须清晰地界定问题。云端转发过程中的“卡顿”通常表现为请求响应延迟显著增加、数据包传输时断时续或视频/音频流媒体出现缓冲与跳帧;而“报错”则更为直接,以明确的错误代码(如5xx服务器错误、4xx客户端错误、连接超时、证书错误等)形式中断流程。两者往往互为因果:持续的卡顿可能最终触发超时报错,而频繁的报错重试又会加剧网络拥堵与卡顿。因此,我们的修复方案必须秉持系统性思维,将两者纳入统一的诊断框架。

第一阶段:系统性诊断与根因定位

修复的第一步是精准定位病灶,而非盲目用药。一个高效的诊断流程应遵循由外及内、由表及里的原则。

1.

客户端与环境排查

:首先排除本地干扰。检查用户端的网络连接质量(延迟、抖动、丢包率)、设备性能及本地防火墙/安全软件设置。同时,确认所使用的SDK或API版本是否为最新,旧版本可能存在已知兼容性问题。

2.

网络链路追踪

:利用`traceroute`、`mtr`等工具,可视化数据包从源端到云服务端的完整路径。重点观察在哪些网络跃点出现延迟骤增或丢包。这有助于区分是用户本地网络问题、互联网服务提供商(ISP)中间链路问题,还是云服务商网络边界问题。

3.

云服务端深度监控

:进入云平台内部监控体系。关键指标包括: –

资源利用率

:检查转发服务所在实例的CPU、内存、磁盘I/O(特别是对于涉及文件转发的场景)是否持续高位运行,甚至达到瓶颈。 –

网络指标

:关注云服务器实例的网络入带宽、出带宽、连接数(Concurrent Connections)、新建连接速率(New Connections per Second)。带宽饱和或连接数耗尽是导致卡顿的常见原因。 –

应用层指标

:分析应用日志,关注请求处理时长(P95, P99分位值)、错误率、队列长度。如果某个特定API接口或转发规则错误率畸高,则问题可能出在业务逻辑或代码实现上。 –

依赖服务健康度

:云端转发服务往往依赖数据库、缓存(如Redis)、消息队列(如Kafka)、身份认证服务等。任何下游服务的延迟或故障都会向上传导。

4.

日志与错误码分析

:详细解析报错信息。例如,“502 Bad Gateway”通常指向后端服务不可用;“504 Gateway Timeout”表明请求在代理层等待后端响应超时。结合日志中的时间戳、请求ID(Request ID),可以精准追踪单次失败请求的完整生命周期,定位是在认证、路由、处理还是返回环节出现了问题。

第二阶段:针对性优化与修复实施

根据诊断结果,采取分层、针对性的优化措施。

1.

资源层优化

: –

弹性伸缩

:配置基于CPU利用率、网络带宽或自定义业务指标的自动伸缩组(Auto Scaling Group),确保在流量高峰时能自动扩容实例,低谷时缩容以节约成本。 –

实例选型升级

:若计算密集型转发导致CPU持续高负载,可考虑升级为计算优化型实例;若存在大量内存数据交换,则内存优化型实例更佳;对于网络密集型应用,选择支持增强网络、具有更高网络带宽的实例系列。 –

存储优化

:若涉及大量临时文件或缓存,考虑将磁盘更换为高性能SSD,或使用内存文件系统。

2.

网络层优化

: –

加速与优化链路

:对于跨地域或跨国转发,启用云服务商提供的全球加速服务或购买高质量的网络传输产品,通过优化路由和接入点,大幅降低延迟和抖动。 –

连接管理与复用

:在应用代码中实现并优化HTTP长连接(Keep-Alive)池、数据库连接池,避免频繁创建和销毁连接的开销。合理配置TCP参数(如`tcp_tw_reuse`、`tcp_max_tw_buckets`等)以应对高并发短连接场景。 –

负载均衡策略调优

:检查并调整负载均衡器(如CLB、ALB)的健康检查频率与阈值、会话保持(粘滞会话)策略,以及后端服务器权重。将流量更智能地分发到健康的实例上。

3.

应用架构与代码层优化

: –

异步与非阻塞设计

:将耗时操作(如大文件处理、复杂计算、外部服务调用)异步化,避免阻塞主请求线程。采用响应式编程或消息队列进行解耦。 –

缓存策略

:在多个层级实施缓存。使用CDN缓存静态资源;在应用层缓存频繁请求的转发规则、用户令牌或热点数据;利用Redis等内存数据库缓存中间结果。 –

超时与重试机制

:为所有外部服务调用设置合理的连接超时、读写超时时间,并实现具有退避策略(如指数退避)的智能重试机制,避免因个别节点故障导致雪崩。 –

代码性能剖析

:使用性能剖析工具(Profiler)定位代码中的“热点”(Hot Spot),优化低效算法、减少不必要的序列化/反序列化、压缩传输数据。

4.

容错与高可用设计

: –

多可用区部署

:将转发服务部署在同一个地域的多个可用区(Availability Zone),实现跨机房容灾,避免单可用区故障导致服务中断。 –

断路器模式

:集成断路器(如Hystrix、Resilience4j),当对某个下游服务的调用失败率达到阈值时,自动熔断,快速失败并给予上游服务明确反馈,防止故障扩散。 –

优雅降级与限流

:制定服务降级策略,在系统压力过大时,暂时关闭非核心功能(如详细日志记录、高级数据校验),保障核心转发流程。配置精准的限流规则(如令牌桶、漏桶算法),防止突发流量击垮系统。

第三阶段:持续监控与预防性维护

优化并非一劳永逸,建立持续监控与反馈闭环至关重要。

1.

建立全方位监控仪表盘

:整合资源、网络、应用、业务(如转发成功率、端到端延迟)等关键指标,实现可视化实时监控,设置智能告警。

2.

定期压力测试与混沌工程

:定期进行模拟真实场景的压力测试,了解系统的性能边界。引入混沌工程实践,有计划地注入故障(如随机终止实例、模拟网络延迟),检验系统的弹性和自恢复能力。

3.

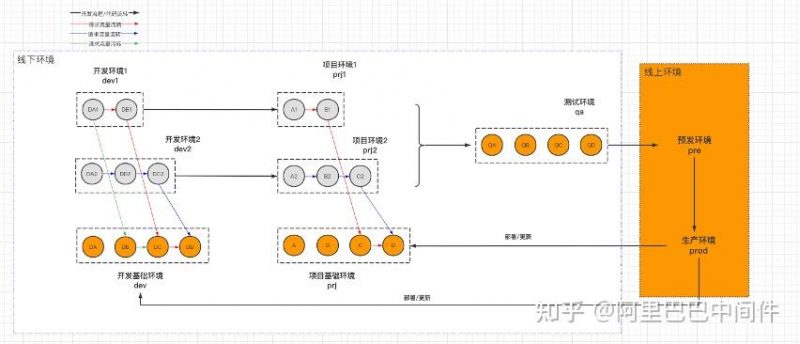

版本与变更管理

:任何代码、配置或基础设施的变更都应通过严格的预发布环境测试,并采用蓝绿部署或金丝雀发布等策略,逐步放量,密切观察新版本对转发性能的影响。

云端转发卡顿与报错的修复,是一项融合了基础设施运维、网络工程、软件架构与性能优化的综合性工程。它要求我们从被动救火转向主动治理,通过建立完善的监控诊断体系,实施分层、精准的优化策略,并最终构建起具备弹性、可观测性和高可用的现代化云端转发架构。唯有如此,方能确保数据之河在云端始终流畅奔腾,为终端用户提供稳定可靠的服务体验。

系统更新后备忘录和通讯录都没了,能恢复吗

可以做数据恢复,最好不要自己尝试数据恢复,否则可能导致数据不可逆恢复。

如果你选择数据恢复的话,你要知道,数据在没有被覆盖前是可以恢复的,哪怕删除或者格式化都可以回复。

但是是建立在没有被覆盖的前提下,如果你更新完系统以后,又重新建立了新的备忘录或者通讯录就会导致数据被覆盖。

如果只是被覆盖了一小部分那么其他的也可以恢复出来。

结合你自己的情况考录吧,回想一下你自己有没有其他的备份,比如微信QQ都有备份功能,有没有备份在里面过。

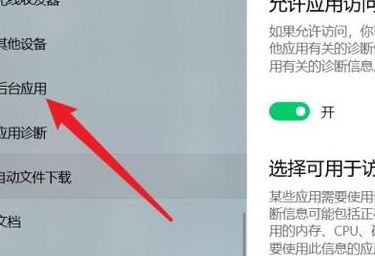

linux nginx 403 forbidden怎么解决

如果报错了40x 50x之类的错误,证明至少防火墙是没问题的。

可能是因为没有index页或index页错误。

或者在配置文件内 没有 index ; 这行。

在或者 网页根目录 权限不对。

对于端口转发的nginx网站 (某些集成的软件,比如gogs),是不需要index参数的。

nginx奇怪的超时110: Connection timed out

很明显是架构问题,nginx本身可能也存在原因,而不是后端,不然另一台nginx就也会爆超时,那么你的2个nginx是做反向代理到后方对吧,你的业务会话超时时间是多少,这个可能要问研发,当nginxA收到数据向后发送代理时,开始进行会话传输,假如说会话超时是10S,断开后,经过5S,数据又到nginxB了,那么先前的会话并没有断开,你再去连肯定会超时,所以解决方案就是看下会话时间还有nginx的会话保持时间是多少,建议改成0或者自己调节,默认记得keepalive_timeout是60,如果架构是一台nginx做反向代理,基本没有这个问题。可能我理解也有不对

暂无评论内容