近年来,短视频平台快速崛起,成为人们日常生活中不可或缺的一部分。其中,快手作为国内领先的短视频应用,拥有庞大的用户群体和丰富的内容生态。近期有用户爆料称,快手平台上存在大量假人账号,甚至这些账号可以购买平台的SVIP服务。这一现象不仅引发了用户对平台监管能力的质疑,也暴露了快手在账号审核和内容管理方面的漏洞。作为一篇分析性文章,本文将从技术、经济、社会及平台治理等角度,深入探讨这一问题的成因、影响及可能的解决路径。

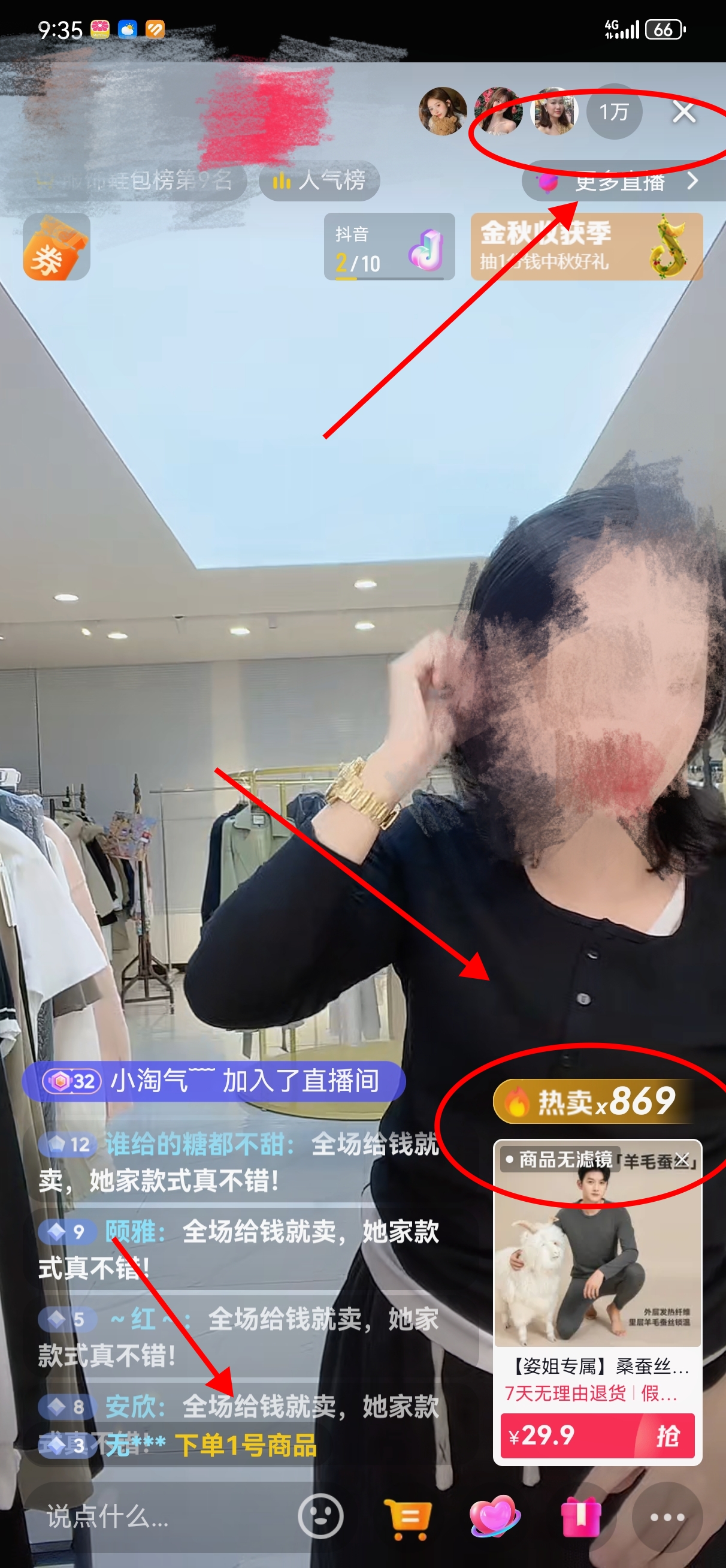

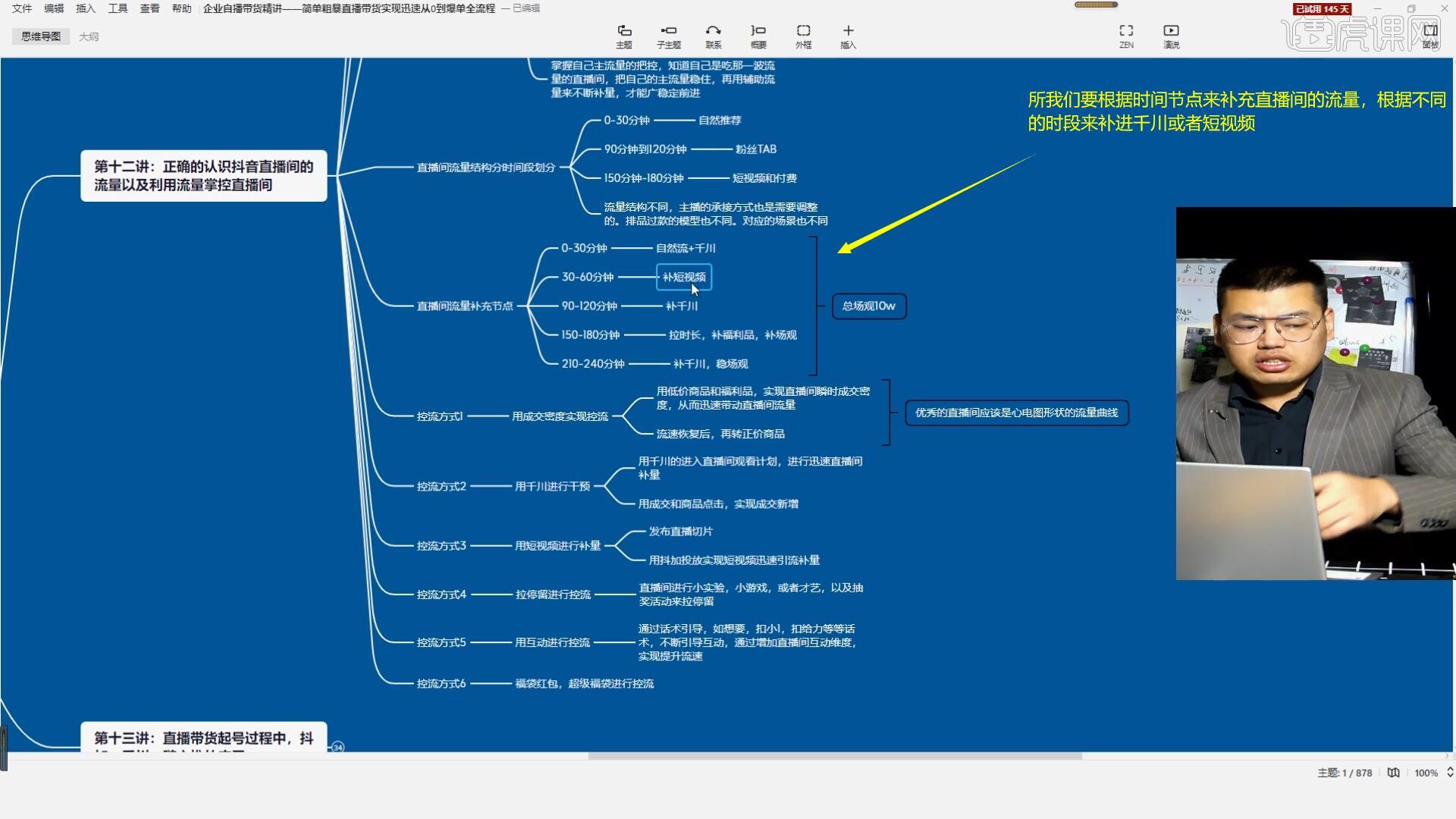

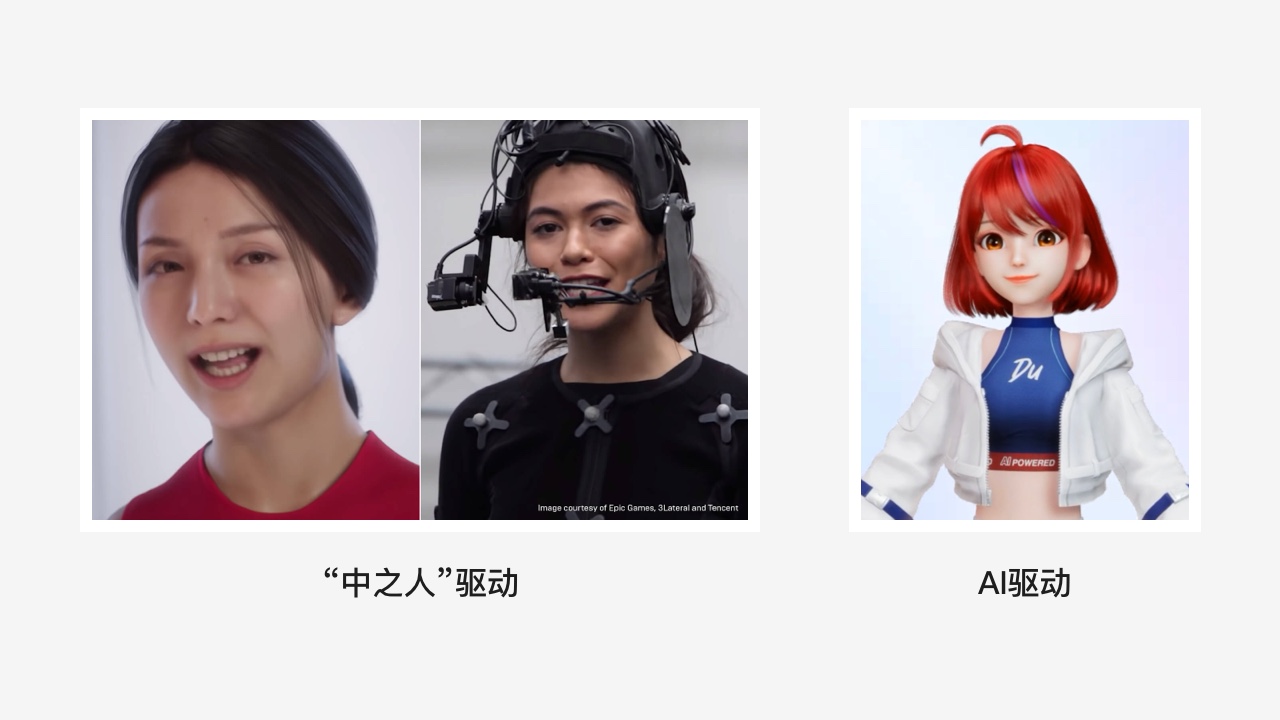

从技术层面来看,假人账号的存在并非快手特有,而是互联网平台普遍面临的挑战。假人账号通常由自动化程序或脚本生成,通过伪造身份信息、头像、昵称等手段,模拟真实用户行为。在快手平台上,这些账号可能被用于刷粉、刷赞、发布垃圾内容,甚至参与恶意营销活动。值得注意的是,快手SVIP服务旨在为付费用户提供个性化功能,如专属标识、优先展示等。假人账号能够购买SVIP服务,说明平台在身份验证环节存在技术漏洞。例如,支付环节的验证机制可能不够严格,允许虚拟身份绕过实名认证;或者平台对账号行为的监测算法未能有效识别异常操作。这些技术缺陷为假人账号的生存提供了土壤。

从经济角度分析,假人账号购买SVIP服务背后可能存在一条灰色产业链。这些账号的运营者往往以盈利为目的,通过批量注册和运营假人账号,获取平台流量红利。例如,假人账号用于刷量后,可以帮助某些主播或商家提升数据表现,从而吸引真实用户关注。而购买SVIP服务,则可能进一步强化这些账号的可信度,使其在平台上获得更高权重。平台从SVIP付费中获取收入,但若用户发现这些服务被虚假账号滥用,将引发对平台公正性的质疑。长期来看,这种行为会损害平台的商业声誉,导致真实用户流失,进而影响广告收入和市场份额。

再者,从社会层面看,假人账号的泛滥对用户信任和网络生态造成负面影响。快手作为一个内容分享平台,其核心价值在于连接真实的人和真实的生活。假人账号的存在破坏了这一基础,使得用户难以区分真实内容与虚假信息。例如,用户可能会被假人账号的虚假评论或点赞误导,做出不准确的判断。同时,这一问题还可能加剧“信息茧房”效应,因为算法会根据假人账号的互动行为推送内容,误导用户的个性化体验。更严重的是,假人账号被用于不当目的时,可能涉及诈骗、传播不良信息等违法行为,威胁用户的财产安全和社会稳定。

从平台治理层面看,快手在监管漏洞上的失控反映了当前内容管理机制的局限性。一方面,平台可能过于追求用户增长和活跃度,忽视了账号质量的把控。例如,在注册环节简化流程以吸引新用户,却未能有效识别假人账号。另一方面,平台对假人账号的动态监测和处置往往滞后。尽管快手声称拥有AI审核系统,但技术手段难以完全覆盖所有异常行为。假人账号购买SVIP服务后,可能利用高级权限规避审查,进一步增加了监管难度。平台对违规账号的处罚力度可能存在不足,例如只采取封号等临时措施,而未深挖背后产业链,导致问题屡禁不止。

针对这一问题,快手需要从多个维度进行改进。在技术层面,应加强账号验证机制,比如引入人脸识别、行为模式分析等技术,提高假人账号的识别率。在支付环节,可建立更严格的实名认证流程,确保SVIP服务仅面向真实用户。平台还可以利用机器学习算法,实时监测账号的互动频率、内容质量等指标,从源头阻断假人账号的形成。在经济层面,快手应加大对灰色产业链的打击力度,例如与监管部门合作,追究批量注册和利用假人账号牟利的法律责任。同时,平台需建立更透明的反馈机制,鼓励用户举报疑似假人账号,并定期公布治理成果。在社会层面,快手应加强用户教育,提升公众对假人账号的防范意识,并通过优化算法推荐,减少虚假信息传播。

快手假人账号购买SVIP服务的问题并非孤立事件,而是平台生态失衡的缩影。它揭示了技术、经济、社会及平台治理等多层面的交织矛盾。作为编辑,我认为快手及其同类平台需要重视这一警示,积极反思自身监管漏洞,而不是仅仅依靠技术修复。只有通过持续创新和严格管理,才能维护用户信任和网络健康。未来,平台治理不应仅是企业的内部事务,更应成为行业规范和公共讨论的焦点。对于用户而言,保持对平台行为的警惕和批判态度,也是推动改善的重要力量。

暂无评论内容